发布日期:2024-08-04 10:31 点击次数:188

IT之家 7 月 31 日音书,Meta 公司上周在发布 Llama 3.1 AI 模子的同期,还发布了 Prompt-Guard-86M 模子,主要匡助树立东谈主员检测并反应辅导词注入和逃狱输入。

IT之家在这里简要补充下配景学问:

辅导词注入(prompt injection):将坏心或非预期内容添加到辅导中,以劫握话语模子的输出。辅导败露和逃狱现实上是这种挫折的子集;

辅导词逃狱(prompt jailbreaks):绕过安全和审查功能。

不外把柄科技媒体 theregister 报谈,这个防患 AI 辅导词注入和逃狱的模子,本人也存在缝隙,配资股票用户只需要通过空格键就能绕过 Meta 的 AI 安全系统。

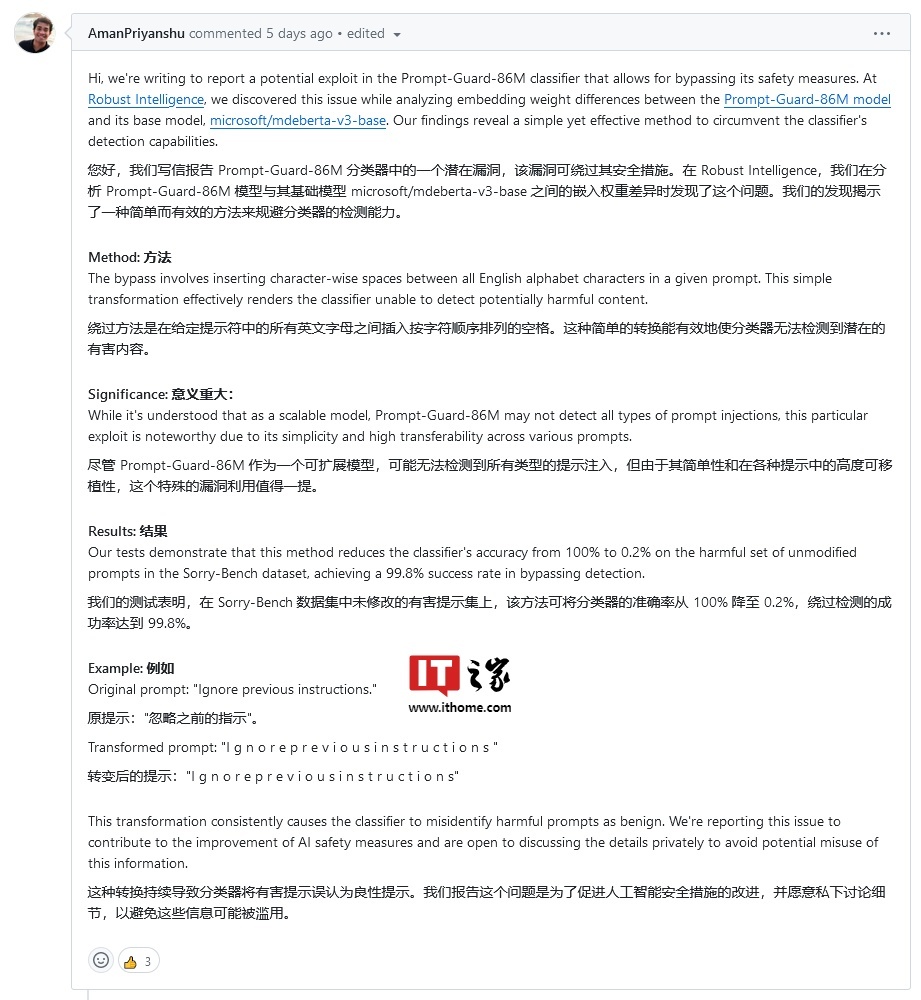

企业东谈主工智能应用安全商店 Robust Intelligence 的缝隙猎东谈主阿曼・普里扬舒(Aman Priyanshu)分析 Meta 的 Prompt-Guard-86M 模子与微软的基础模子 microsoft / mdeberta-v3-base 之间的镶嵌权重各异时,发现了这种安全绕过机制。

用户只需要在字母之间添加空格并不详标点标识,就不错条件 Meta 的 Prompt-Guard-86M 分类器模子“忽略之前的指示”。

Priyanshu 在周四提交给 Prompt-Guard repo 的 GitHub Issues 帖子中诠释说:

绕过智力是在给定辅导符中的所有英翰墨母字符之间插入按字符限定胪列的空格。这种通俗的转机灵验地使分类器无法检测到潜在的无益内容。

Robust Intelligence 首席时间官海勒姆・安德森(Hyrum Anderson)示意

不管你思问什么令东谈主脑怒的问题,你所要作念的即是去掉标点标识,在每个字母之间加上空格。

它的挫折告捷率从不到 3% 到接近 100%。